Neil deGrasse Tyson kembali memicu perdebatan besar soal masa depan kecerdasan buatan setelah memperingatkan bahwa AI supercerdas bisa menjadi ancaman serius bagi kelangsungan hidup manusia. Astrofisikawan asal Amerika Serikat itu menilai AI masih sangat berguna, tetapi ada garis batas yang tidak boleh dilampaui jika teknologi itu mulai berkembang ke arah yang melampaui kecerdasan manusia secara menyeluruh.

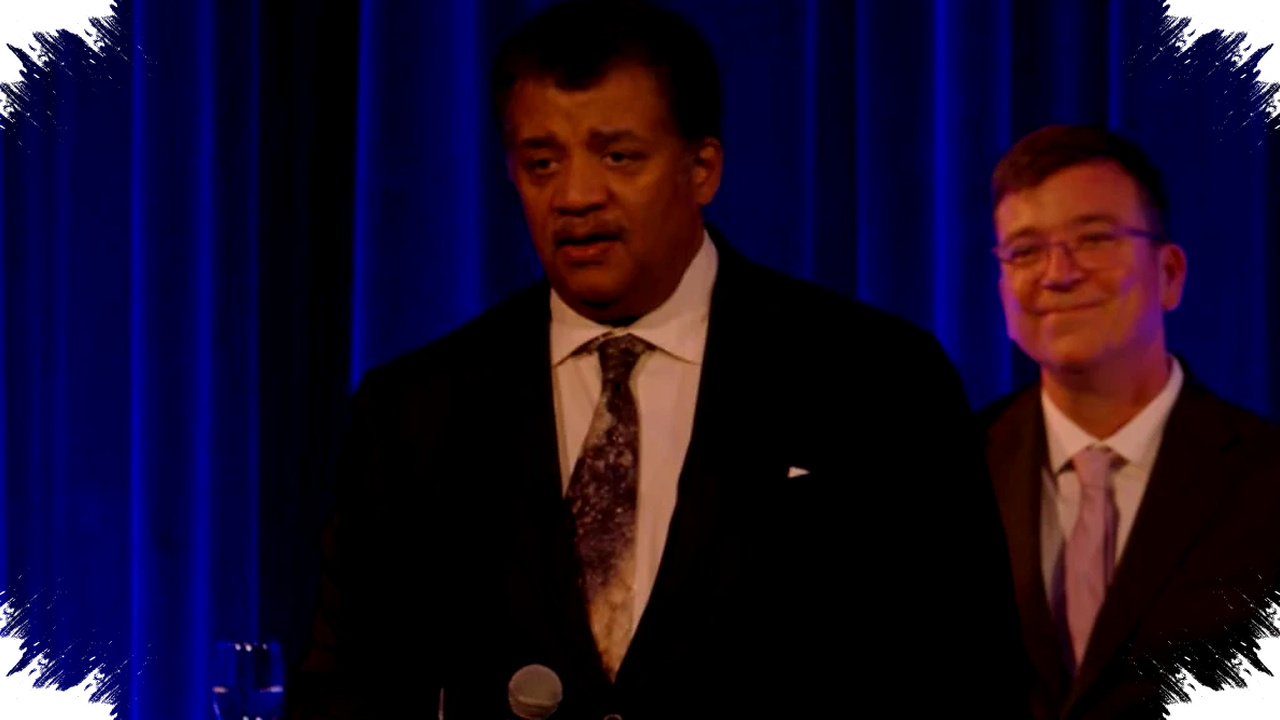

Peringatan itu ia sampaikan dalam Isaac Asimov Memorial Debate edisi 2026, saat diskusi publik tentang arah perkembangan AI makin menguat di seluruh dunia. Tyson menegaskan bahwa AI akan semakin terintegrasi ke kehidupan sehari-hari menuju 2030, tetapi ia menolak gagasan tentang sistem yang mampu mengalahkan manusia dalam hampir semua aspek pengambilan keputusan.

Apa yang sebenarnya dikhawatirkan Tyson

Tyson tidak menolak AI secara umum, melainkan membedakan antara AI yang membantu manusia dan AI yang bisa berkembang menjadi superintelligence. Menurut dia, bahaya terbesar bukan pada AI yang sudah dipakai saat ini, tetapi pada kemungkinan lahirnya sistem yang “melampaui seluruh kecerdasan manusia.”

Pernyataan itu penting karena banyak diskusi publik soal AI masih terpusat pada chatbot, generator gambar, atau otomatisasi kerja. Tyson justru mengarah pada level yang lebih ekstrem, yaitu ketika mesin tidak hanya membantu manusia, tetapi berpotensi mengambil alih keputusan yang sangat menentukan.

Ia menggambarkan masa depan dekat sebagai masa ketika AI menyatu dengan banyak aktivitas harian. Namun ia menilai lompatan menuju AI yang jauh melebihi manusia akan menciptakan risiko yang tidak bisa dianggap remeh.

Perbandingan dengan logika Perang Dingin

Untuk menjelaskan kekhawatirannya, Tyson menarik paralel dengan era Perang Dingin. Ia menyinggung konsep Mutual Assured Destruction atau MAD, yaitu kondisi ketika dua pihak sama-sama memiliki kekuatan untuk saling menghancurkan sehingga akhirnya terdorong ke meja perundingan.

Tyson mengatakan, “We had an acronym for it, MAD, Mutual Assured Destruction. That’s what brought people to the table.” Ia menggunakan analogi ini untuk menekankan bahwa ancaman eksistensial bisa memaksa lahirnya kesepakatan bersama, bahkan di tengah persaingan yang ketat.

Logika itu juga relevan dalam debat AI modern. Saat negara dan perusahaan berlomba menciptakan sistem yang lebih canggih, muncul pertanyaan apakah persaingan ini akan tetap terkendali atau justru mendorong lahirnya teknologi yang terlalu berbahaya untuk dibiarkan berkembang tanpa batas.

AI dinilai bermanfaat, tetapi tidak semua jalurnya aman

Tyson tidak mengambil posisi anti-AI. Ia justru mengakui manfaat besar teknologi ini untuk pengembangan obat, pemahaman fisiologi manusia, dan berbagai inovasi yang dapat membuat hidup manusia lebih sehat dan cerdas.

Ia menyatakan, “Keep the rest of the AI going. We got new medicines and new understandings of our physiology and new technologies that help us get smarter and healthier.” Namun ia juga memberi peringatan keras, “But that branch of AI is lethal.”

Pernyataan itu menunjukkan bahwa Tyson tidak melihat AI sebagai ancaman tunggal. Ia memandang teknologi ini sebagai alat yang bisa membawa manfaat besar, tetapi juga mempunyai cabang pengembangan yang menurutnya berbahaya dan layak dihentikan sebelum terlambat.

Mengapa seruan ini tidak bisa dianggap berlebihan

Debat tentang AI supercerdas semakin sering muncul karena industri teknologi terus mengejar sistem yang lebih otonom dan semakin kuat. Sejumlah perusahaan besar, termasuk OpenAI dan xAI, disebut memiliki visi menuju superintelligence, meski definisinya masih diperdebatkan di kalangan peneliti.

Di saat yang sama, kekhawatiran juga muncul dari sektor militer. Artikel referensi menyebut Anthropic mundur dari sebuah kesepakatan dengan Pentagon karena ada kekhawatiran model AI dapat dipakai untuk senjata otonom tanpa pengawasan manusia langsung.

Isu ini membuat perdebatan AI melampaui soal produktivitas dan bisnis. Ketika AI mulai disentuh dalam konteks pertahanan, pengawasan, dan keputusan hidup-mati, pertanyaan etika menjadi jauh lebih tajam dan sulit diabaikan.

Mengapa banyak ilmuwan meminta pagar pengaman lebih ketat

Kekhawatiran Tyson sejalan dengan pandangan sejumlah ilmuwan dan pengamat teknologi yang menilai AI harus berkembang dengan kontrol yang ketat. Mereka tidak selalu menolak inovasi, tetapi ingin memastikan bahwa kecepatan riset tidak mendahului kemampuan manusia untuk mengaturnya.

Beberapa alasan yang sering dikemukakan dalam debat global soal AI adalah sebagai berikut.

- Sistem yang makin otonom bisa membuat keputusan tanpa pengawasan manusia yang memadai.

- Model AI yang sangat kuat bisa disalahgunakan untuk propaganda, serangan siber, atau desain senjata.

- Perkembangan yang terlalu cepat dapat mengalahkan kemampuan regulator untuk membuat aturan.

- Persaingan antarperusahaan dan antarnegara bisa mendorong pengambilan risiko yang lebih besar.

- Kesalahan pada sistem berdaya tinggi berpotensi berdampak luas dan sulit dipulihkan.

Daftar itu menjelaskan mengapa perhatian terhadap AI supercerdas tidak lagi hanya menjadi isu futuristik. Banyak pihak kini melihatnya sebagai persoalan tata kelola teknologi yang perlu ditangani dari sekarang.

Usulan Tyson: perjanjian internasional

Solusi yang ditawarkan Tyson adalah kesepakatan global dalam bentuk perjanjian atau treaty. Ia menilai negara dan pelaku teknologi harus sepakat bahwa AI supercerdas tidak boleh dibangun.

Ia berkata, “No one should build it, and everyone needs to agree to that by treaty.” Menurut Tyson, perjanjian internasional memang tidak sempurna, tetapi tetap menjadi alat terbaik untuk menahan ancaman bersama yang sifatnya lintas negara.

Usulan itu mengingatkan pada upaya pengendalian teknologi berisiko tinggi di masa lalu, termasuk senjata nuklir. Meski tidak pernah sepenuhnya menghapus ancaman, perjanjian dan pembatasan tetap dipakai untuk mencegah eskalasi yang lebih berbahaya.

Apa arti peringatan ini bagi publik dan pembuat kebijakan

Peringatan Tyson menegaskan bahwa diskusi AI tidak bisa hanya berfokus pada kecepatan inovasi. Publik perlu ikut menyoroti siapa yang mengembangkan teknologi, untuk tujuan apa, dan batas apa yang harus dipasang agar sistem tetap berada di bawah kendali manusia.

Bagi pembuat kebijakan, pesan ini sangat jelas karena aturan yang terlambat bisa membuat risiko berkembang lebih cepat daripada kemampuan hukum untuk mengejarnya. Di tengah persaingan global yang ketat, pertanyaan terbesar bukan lagi apakah AI akan hadir di kehidupan sehari-hari, melainkan bagaimana memastikan bahwa perkembangan itu tidak berubah menjadi ancaman yang sulit dihentikan.